SEO für Kliniken: Anforderungen, Strategie und Umsetzung. Klinikerfahrener SEO Freelancer...

WeiterlesenIndividuelle SEO Workshops & Schulungen

Neben der eigenen Agentur war ich lange Jahre für namhafte Agenturen wie Scholz & Friends, IBM iX, der Bauer Media Group und den Internetwarriors tätig.

So durfte ich die verschiedensten Kunden aus allen Themengebieten und in allen Größen in allen möglichen Bereichen der SEO betreuen und beraten:

Inhalt:

- 1 Monatliche SEO Betreuung

- 2 Der Vertrag

- 3 Welche Keywords gibt es?

- 4 WAS IST DIE ROBOTS.TXT?

- 5 FUNKTIONSWEISE DER ROBOTS.TXT

- 6 ERWEITERTE BEFEHLE UND OPTIONEN

- 7 ERSTELLUNG UND VERWALTUNG EINER ROBOTS.TXT

- 8 BEISPIELE FÜR VERSCHIEDENE ANWENDUNGEN

- 9 BEST PRACTICES FÜR ROBOTS.TXT

- 10 HÄUFIGE FEHLER UND DEREN VERMEIDUNG

Monatliche SEO Betreuung

Bei der Frage ob ein SEO Freelancer bzw. eine Agentur für meine Webseite engagiert werden sollte, müssen einige Argumente abgewogen werden.

Zuerst stelle ich die Vorteile der Beauftragung eines SEO Freelancers dar. Im zweiten Abschnitt werden die Vorzüge einer Agentur dargestellt. Hiernach können sie nach ihren individuellen Anforderungen die beste passende Lösung finden.

Hier also die Argumente, die für die Beauftragung eines SEO Freelancers sprechen:

- Der SEO Freelancer arbeitet gewöhnlich von zu Hause aus oder ist bei Ihnen intern im Büro untergebracht. Hierdurch entfallen bei der Kostenberechnung eines Freelancers die eventuellen Mietkosten für ein teures, imageträchtiges Büro weg – ebenso dessen Nebenkosten und die Kosten für eine teure Büroausstattung oder Miete für nicht SEO relevante Tools). Diese Kosten machen normalerweise einen nicht geringen Anteil bei der Abrechnung aus. Sie sparen also bares Geld!

- Wie die Kosten für ein Büro, fallen auch die Kosten für die anderen bei der Agentur Beschäftigten Mitarbeiter weg (hohe Agenturkosten, die auch anfallen, wenn die jeweiligen Mitarbeiter nicht in ihrem eigenen Kundenprojekt arbeiten). Sie sparen also wiederum bares Geld!

- Mangelnde SEO-Qualität in Agenturen: In Agenturen arbeiten viele Gewerke gemeinsam. Jedes Gewerk profiliert sich natürlich eigenständig innerhalb der Agentur (bei „normalen“ Digitalagenturen bildet der SEO-Bereich bzw. das Onlinemarketing den kleinsten bzw. schwächsten Bereich). SEO-Maßnahmen betreffen aber alle anderen Agenturgewerke (von der Technik, über Design und UX bis hin zur Redaktion): Hierdurch entsteht eine Konkurrenzsituation, bei der SEO-Maßnahmen gegenüber größeren Technik- oder Designteams meiner Erfahrung nach oft hinten angestellt werden bzw. schlechte Kompromisse gefunden werden. In meiner langen Agenturarbeit bildete die Verbesserung der SEO-Wahrnehmung bzw. des SEO-Standings innerhalb des Produktionsprozesses immer einen großen Teil meiner Arbeit, die ich lieber für den Kunden direkt genutzt hätte.

Selbst in der heute oft angewandten agilen, interdisziplinären Produktentwicklung ist der SEO-Berater nicht direkt in den einzelnen Projektgruppen fest integriert, sondern arbeitet als beratender Außenstehender (Subject Matter Expert). Hierdurch wird der notwendige ständige Kontakt zum interdisziplinären Entwicklungsteam nicht gewährleistet (der SEO greift hier nur auf Informationen durch einzelne Standups bzw. Dokumentationen eventuell schon erledigter Arbeit zurück). Fehler müssen also kosten- und zeitintensiv nachträglich ausgebügelt werden (dann eben auch wieder mit vielen nötigen „schlechten“ Kompromissen). Verschärfend kommt hier hinzu, das bei jedem Projekt die Zusammenstellung eines Teams geändert wird, der SEO Berater muss also wieder vom Nullpunkt anfangen bis alle anderen Mitarbeiter den gleichen Wissensstand haben (und das auch noch bei den hohen Personalfluktationen innerhalb der Agenturen)

- Fehlende Spezialisierung der Agenturen gegenüber einem SEO Freelancer: Alle Agenturen versprechen und behaupten von sich gute SEO zu machen (habe nie etwas anderes von ihnen gehört…). Alle schon genannten Argumente verhindern aber oft gute SEO-Arbeit: Agenturen berücksichtigen immer viele Bereiche und besitzen starre Prozesse der Bearbeitung. Die fehlende Spezialisierung verhindert oft eine von Anfang an strategische und nachhaltige SEO für den Kunden. Ebenso werden nicht konzentrierte, individuelle SEO Maßnahmen priorisiert, die schnell sichtbare Ergebnisse liefern können.

- Fehlende Transparenz der Agenturen: Die Arbeit eines SEO Freelancers bildet keinen untergeordneten Teil einer Agentur Gesamtabrechnung: Alle Maßnahmen sind individuell abgesprochen, durchgeführt und dokumentiert. Auch praktisch gerne angewandte „Schummeleien“ können nicht durchgeführt werden: SEO Hilfs- bzw. Zuarbeiten werden in mancher Agentur von billigen Junioren durchgeführt und vom teuren Senior dann in Rechnung gestellt…

- Der SEO Freelancer als direkter Ansprechpartner: Die Zusammenarbeit mit einem SEO Freelancer gestaltet sich meist unkomplizierter als mit einer Agentur. Der direkte Kontakt sorgt für eine gewisse Flexibilität und damit auch Schnelligkeit innerhalb der Zusammenarbeit.

- Der SEO Freelancer ist mehr als Agenturen am wirtschaftlichen Erfolg des Kunden interessiert: Der projektbezogene Freelancer verkauft nicht einfach umfangreiche Serviceverträge, sondern ist an einer erfolgreichen Zusammenarbeit bzw. Weiterbeschäftigung sowie Empfehlungen interessiert. SEO ist hier kein reiner Trafficbringer, sondern Conversionsnahe.

Strategische SEO Beratung vom erfahrenen Freelancer:

Robert Goese – SEO Beratung: Tel. 030 / 53 00 56 01

Aktualisiert am: 27.03.2025

Der Vertrag

Welche Keywords gibt es?

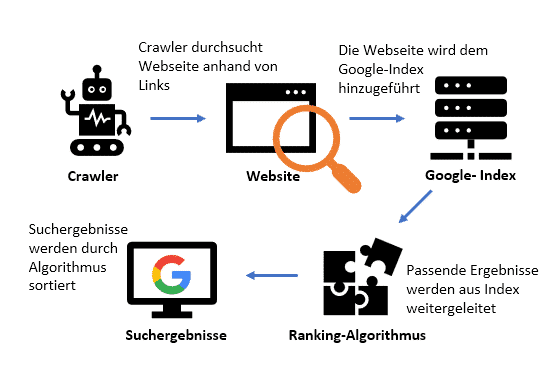

Grundlage der technischen SEO ist die Gewährleistung der Crawlbarkeit der URLs durch den Googlebot

Die Crawlbarkeit und Indexierbarkeit ist für jede Website absolut fundamental:

Ohne die Crawlbarkeit ist es den Suchmaschinen (und damit auch den Usern) nicht möglich die Seite zu finden. Durch die Crawlbarkeit wird der Zugang des Suchmaschinen- Crawlers bzw. Googlebots erst zur Website ermöglicht. Das klingt einfach, ist es meist auch und trotzdem passieren hier oft die größten Fehler, die sofort schwerwiegende Auswirkungen haben.

Bei der Crawlbarkeitsanalyse in der technischen SEO werden hier also die Angaben der robots.txt analysiert. Wichtige Dateien dürfen nicht durch die robots.txt ausgeschlossen werden, unwichtige können dies aber gerne (mit Einschränkungen…)

Weiterhin spielen die Status Codes der einzelnen URLs eine Rolle. Es wird also untersucht, ob alle wichtige Dateien überhaupt erreichbar sind, oder auch ob zu viele 404-Fehler die Usability der Website negativ beeinflusst (und damit auch das Ranking).

Das Crawlen der Website durch den Googlebot wird durch die Bereitstellung von XML-Sitemaps oft wesentlich vereinfacht. Hier sollten wirklich alle wichtigen Dateien hinterlegt sein. Durch die XML-Sitemap werden so auch Seiten gefunden, die schlecht oder gar nicht verlinkt sind. Unwichtige Dateien sollten hier nicht auftauchen. Alle Sitemaps sollten auch bei Google in der Search Console hinterlegt werden.

Bei großen Websites spielt auch das Crawlbudget eine Rolle – denn dies ist begrenzt. Um sicherzustellen, dass alle wichtigen Seiten auch im Index landen, muss hier dann optimiert werden

Crawling durch den Googlebot

Nach dem Crawl kommt die Indexierung

Indexierung ist der nächste Schritt nach dem Crawlen. Während dieses Prozesses speichert die Suchmaschine die Informationen, die beim Crawlen gesammelt wurden, in einer großen Datenbank – dem Index. Diese Datenbank enthält eine strukturierte Sammlung von Informationen über alle gecrawlten Seiten, die es der Suchmaschine ermöglicht, schnell relevante Ergebnisse auf Nutzeranfragen zu liefern. Es gilt also, die Informationen so darzustellen, dass sie hier schnell und richtig aufgenommen werden bzw. die Einordnung und Relevanzbeurteilung seitens Google & Co.zu erleichtert werden.

Crawling und Indexierung sind also entscheidend für die Funktionsweise von Suchmaschinen. Ohne diese Prozesse könnten sie keine umfassenden und relevanten Suchergebnisse liefern.

Indexierung

„Gecrawlt ist noch lange nicht indexiert“

Altes SEO Sprichwort

WAS IST DIE ROBOTS.TXT?

Die robots.txt-Datei ist eine einfache Textdatei, die im Stammverzeichnis einer Website abgelegt wird. Sie gibt Webcrawlern Anweisungen, welche Bereiche der Website sie durchsuchen dürfen und welche nicht. Diese Datei ist ein wichtiger Bestandteil des Robots Exclusion Protocol, das seit 1994 existiert und von den meisten Suchmaschinen (u.a. von Goggle) respektiert wird.

FUNKTIONSWEISE DER ROBOTS.TXT

Aufbau und Syntax

Die robots.txt-Datei besteht aus einer Reihe von Anweisungen, die aus zwei Hauptkomponenten bestehen: „User-agent“ und „Disallow“. Zusätzlich können „Allow“, „Sitemap“ und andere erweiterte Anweisungen verwendet werden.

- User-agent: Identifiziert den Crawler, für den die Anweisungen gelten.

- Disallow: Gibt an, welche Seiten oder Verzeichnisse nicht gecrawlt werden dürfen.

- Allow: Spezifische Anweisung für Googlebot, um das Crawlen von bestimmten Seiten innerhalb eines ansonsten gesperrten Verzeichnisses zu erlauben.

- Sitemap: Verweist auf die Sitemap der Website, um Crawlern die Struktur der Website anzuzeigen .

User-agent: *

Disallow: /private/

Allow: /private/public-file.html

Sitemap: https://www.example.com/sitemap.xml

Der User-Agent

Der User-Agent ist der Name des Webcrawlers, für den die Anweisungen gelten. Durch die Angabe von spezifischen User-Agents können unterschiedliche Anweisungen für verschiedene Crawler festgelegt werden. Der Stern (*) als Platzhalter bedeutet, dass die Anweisungen für alle Crawler gelten.

User-agent: Googlebot

Disallow: /no-google/

User-agent: Bingbot

Disallow: /no-bing/

Disallow

Der User-Agent ist der Name des Webcrawlers, für den die Anweisungen gelten. Durch die Angabe von spezifischen User-Agents können unterschiedliche Anweisungen für verschiedene Crawler festgelegt werden. Der Stern (*) als Platzhalter bedeutet, dass die Anweisungen für alle Crawler gelten.

User-agent: *

Disallow: /admin/

Disallow: /login/

Allow

Die Allow-Anweisung wird in Kombination mit Disallow verwendet, um bestimmte Seiten innerhalb eines gesperrten Verzeichnisses dennoch für das Crawlen freizugeben. Diese Anweisung ist besonders nützlich für komplexe Websites.

User-agent: Googlebot

Disallow: /content/

Allow: /content/public/

XML Sitemap URL

Die Hinterlassung der URL der XML Sitemap erleichtert Google das Crawlen und die Indexierung der Domain. So können die Webcrawler die Sitemap auch finden, wenn diese nicht bei den einzelnenen Suchmaschinen in z.B. der Google Search Console, in den Bing- Webmastertools etc. eingereicht worden ist. Hier können auch mehrere Sitemaps angegeben werden bzw. der Link zur Sitemap Index Datei hinterlassen werden.

Sitemap: https://www.example.com/sitemap.xml

ERWEITERTE BEFEHLE UND OPTIONEN

Crawl Delay (keine Google Unterstützung)

Mit der Crawl-Delay-Anweisung kann die Zeitverzögerung zwischen den Anfragen eines Crawlers eingestellt werden. Dies ist nützlich, um die Serverlast zu verringern.

User-agent: *

Crawl-delay: 10

Host

Der Host-Befehl wird verwendet, um anzugeben, welche Version der Website bevorzugt gecrawlt werden soll, insbesondere bei mehrsprachigen oder regionalen Websites.

User-agent: *

Host: www.example.com

Noindex

Einige Suchmaschinen unterstützten die Noindex-Anweisung in der robots.txt-Datei, um anzugeben, dass bestimmte Seiten nicht in den Index aufgenommen werden sollen. Diese Unterstützung wurde jedoch von Google im September 2019 eingestellt. Stattdessen sollte das Meta-Tag „noindex“ verwendet werden.

User-agent: *

Noindex: /private/

ERSTELLUNG UND VERWALTUNG EINER ROBOTS.TXT

- Öffnen Sie einen Texteditor: Verwenden Sie einen einfachen Texteditor wie Notepad oder TextEdit.

- Schreiben Sie die Anweisungen: Geben Sie die gewünschten Anweisungen für die Crawler ein.

- Speichern Sie die Datei als robots.txt: Achten Sie darauf, dass die Datei als „robots.txt“ gespeichert wird.

- Hochladen in das Stammverzeichnis: Laden Sie die Datei in das Stammverzeichnis Ihrer Website hoch .

BEISPIELE FÜR VERSCHIEDENE ANWENDUNGEN

Blockierung des gesamten Zugriffs

User-agent: *

Disallow: /

Erlauben des Zugriffs auf die gesamte Website:

User-agent: *

Disallow:

Blockierung eines spezifischen Crawlers:

User-agent: Bingbot

Disallow: /

Vermeidung von Duplicate Content

Durch die richtige Konfiguration der robots.txt-Datei können Sie sicherstellen, dass doppelte Inhalte nicht gecrawlt werden und somit das Crawl-Budget effizienter genutzt wird.

User-agent: *

Disallow: /duplicate-content/

Steuerung des Crawl-Budgets

Durch die gezielte Blockierung von irrelevanten oder wenig wichtigen Seiten können Sie sicherstellen, dass das Crawl-Budget auf die wichtigen Seiten konzentriert wird

User-agent: *

Disallow: /irrelevant-section/

BEST PRACTICES FÜR ROBOTS.TXT

Vermeidung sensibler Daten

Stellen Sie sicher, dass keine sensiblen Informationen oder Seiten in der robots.txt-Datei offengelegt werden. Obwohl die Datei Anweisungen zum Blockieren des Crawling gibt, bleibt sie öffentlich zugänglich.

Testen der Datei

Verwenden Sie Tools wie die Google Search Console, um Ihre robots.txt-Datei zu testen und sicherzustellen, dass sie wie gewünscht funktioniert. Das Tool „robots.txt-Tester“ hilft, Syntaxfehler zu identifizieren und zu korrigieren.

Regelmäßige Überprüfung und Aktualisierung

Die robots.txt-Datei sollte regelmäßig überprüft und aktualisiert werden, um sicherzustellen, dass sie den aktuellen Anforderungen und der Struktur der Website entspricht .

Nutzung von Wildcards

Wildcards (z.B. *) können verwendet werden, um Muster zu definieren und mehrere ähnliche URLs zu blockieren.

User-agent: *

Disallow: /temp*

HÄUFIGE FEHLER UND DEREN VERMEIDUNG

I. Fehlerhafte Syntax

Syntaxfehler können dazu führen, dass die Anweisungen in der robots.txt-Datei nicht korrekt interpretiert werden. Verwenden Sie Tools wie den robots.txt-Tester in der Google Search Console, um Fehler zu vermeiden .

II. Blockierung wichtiger Seiten

Vermeiden Sie die Blockierung von Seiten, die für die Indexierung wichtig sind, wie z.B. Hauptkategorien oder wichtige Inhalte. Eine unüberlegte Blockierung kann die Sichtbarkeit Ihrer Website in den Suchergebnissen negativ beeinflussen .

III. Falsche Platzierung der Datei

Die robots.txt-Datei muss im Stammverzeichnis der Website platziert werden. Eine falsche Platzierung, z.B. in einem Unterverzeichnis, wird von den Crawlern nicht erkannt .

IV. Annahme, dass Disallow gleich Noindex ist

Die Anweisung Disallow verhindert das Crawling, jedoch nicht die Indexierung. Um sicherzustellen, dass eine Seite nicht indexiert wird, verwenden Sie das Meta-Tag „noindex“ in der HTML-Datei der Seite .

FAQs zur robots.txt

Was ist eine robots.txt?

Die robots.txt-Datei ist eine einfache Textdatei, die im Stammverzeichnis einer Website abgelegt wird und Anweisungen für Webcrawler enthält, welche Bereiche der Website sie crawlen dürfen und welche nicht.

Warum ist die robots.txt-Datei wichtig?

Die robots.txt-Datei ist wichtig, um das Crawl-Budget effizient zu nutzen, indem irrelevante oder sensible Bereiche der Website vom Crawling ausgeschlossen werden. Sie hilft auch, Serverressourcen zu schonen und das Crawling auf wichtige Seiten zu konzentrieren.

Wie erstelle ich eine robots.txt-Datei?

Um eine robots.txt-Datei zu erstellen, öffnen Sie einen einfachen Texteditor, schreiben die gewünschten Anweisungen (z.B. User-agent, Disallow), speichern die Datei als „robots.txt“ und laden sie in das Stammverzeichnis Ihrer Website hoch.

Was ist eine Sitemap und wie verweise ich darauf?

Eine Sitemap ist eine XML-Datei, die alle wichtigen Seiten einer Website auflistet. Sie können in der robots.txt-Datei auf die Sitemap verweisen, um Crawlern die Struktur der Website zu zeigen.

Kann die robots.txt-Datei die Indexierung einer Seite verhindern?

Die Disallow-Anweisung verhindert nur das Crawlen, nicht die Indexierung. Um sicherzustellen, dass eine Seite nicht indexiert wird, sollten Sie das Meta-Tag „noindex“ in der HTML-Datei der Seite verwenden.

Wie teste ich meine robots.txt-Datei?

Sie können Tools wie die Google Search Console verwenden, um Ihre robots.txt-Datei zu testen und sicherzustellen, dass sie wie gewünscht funktioniert. Der robots.txt-Tester hilft, Syntaxfehler zu identifizieren und zu korrigieren.

Wie verhindere ich Duplicate Content mit robots.txt?

Durch die richtige Konfiguration der robots.txt-Datei können Sie sicherstellen, dass doppelte Inhalte nicht gecrawlt werden, wodurch das Crawl-Budget effizienter genutzt wird

Kann ich bestimmte Crawler blockieren?

Ja, Sie können bestimmte Crawler blockieren, indem Sie den User-Agent des Crawlers angeben und die entsprechenden Disallow-Anweisungen hinzufügen.

Quellen und weiterführende Artikel

Mehr SEO Beratung

Mit Onlineshop SEO ihr Ecommerce nachhaltig vorantreiben: Mehr qualifizierten Traffic,...

WeiterlesenProfessionelle B2B SEO durch erfahrenen SEO Freelancer: Nachhaltig, zielgruppengerecht und...

Weiterlesen